隨著數字化轉型的深入,企業信息系統正朝著松耦合、高可用的微服務架構演進。在這一進程中,服務間的可靠、高效通信成為關鍵。Apache Kafka,作為一個分布式的流處理平臺與消息中間件,憑借其獨特的高性能設計,已成為微服務集成與異步通信的核心基礎設施。本文將探討Kafka的高性能設計哲學,及其在構建現代化、高性能信息系統集成服務中的核心作用。

一、Kafka高性能設計的核心支柱

Kafka的高性能并非偶然,而是源于其精心的架構設計,主要集中在以下幾個方面:

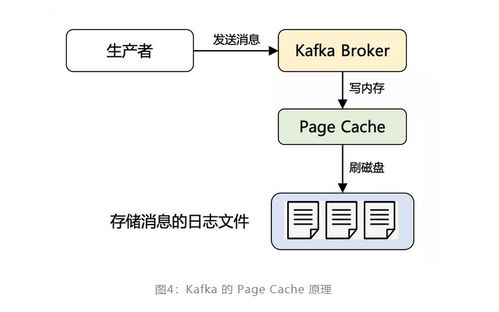

- 順序磁盤I/O與零拷貝技術:與傳統數據庫的隨機讀寫不同,Kafka將消息持久化到磁盤時采用順序追加寫入的方式,其速度甚至可以超過內存的隨機讀寫。在消費者讀取時,Kafka利用操作系統的零拷貝(Zero-copy) 技術,將磁盤文件的數據直接通過網絡發送給消費者,避免了內核緩沖區與用戶緩沖區之間的多次拷貝,極大降低了CPU開銷和上下文切換。

- 分區(Partition)與并行機制:Topic在物理上被劃分為多個分區,分布在不同的Broker上。這種設計實現了數據的水平拆分和負載均衡。生產者和消費者可以并行地向多個分區讀寫數據,從而線性提升系統的整體吞吐量。這是支撐海量數據流處理的基礎。

- 基于日志的持久化與批處理:Kafka將所有消息以僅追加(append-only)的日志形式存儲。生產者發送消息時,并非每條消息都立即觸發網絡和磁盤I/O,而是會先在客戶端進行批量壓縮,積累到一定大小或時間后再批量發送。這種批處理機制顯著減少了網絡往返和I/O操作次數。

- 高效的消費者組模型:Kafka的消費者采用“拉取(Pull)”模式,可以自主控制消費速率和時機。消費者組(Consumer Group)機制使得同一組內的消費者可以共同消費一個Topic的多個分區,實現消費能力的彈性伸縮和高可用,避免了消息隊列常見的“廣播”帶來的性能瓶頸。

二、在信息系統集成服務中的典型應用場景

在微服務架構的信息系統集成中,Kafka扮演著“中樞神經系統”的角色:

- 服務解耦與異步通信:訂單服務在創建訂單后,只需將“訂單創建”事件發布到Kafka的

order-eventsTopic,而庫存服務、物流服務、風控服務等作為獨立的消費者,異步地訂閱并處理該事件。服務間無需直接HTTP/RPC調用,實現了徹底解耦,提高了系統的整體彈性和可維護性。

- 事件溯源與數據流管道:Kafka可以作為所有領域事件的持久化存儲,構建事件溯源(Event Sourcing) 系統。所有改變系統狀態的事件都被順序記錄,為審計、數據回放和構建新的數據視圖提供了可能。Kafka Connect可以方便地將數據從數據庫、日志文件導入Kafka,或從Kafka導出到數據倉庫(如Hadoop、ES),構建實時數據管道。

- 流處理與實時分析:結合Kafka Streams或Flink等流處理框架,可以對流經Kafka的數據進行實時處理。例如,在用戶行為分析系統中,實時計算點擊率、統計在線人數;在風控系統中,實時分析交易流水,識別異常模式。

三、構建高性能集成服務的實踐要點

要充分發揮Kafka的性能優勢,在系統集成設計中需注意:

- 合理的Topic與分區規劃:根據業務域和數據吞吐量設計Topic,避免“大雜燴”。分區數是Kafka并行度的上限,需要根據預期的消費者數量和吞吐量進行合理設置,并預留擴容空間。

- 優化生產與消費配置:生產者端合理配置

batch.size和linger.ms以優化批處理;根據對可靠性的要求選擇acks配置(如acks=1在性能與可靠性間取得平衡)。消費者端注意控制fetch.min.bytes以提升拉取效率,并做好偏移量管理。 - 保障高可用與監控:Kafka集群本身應部署多副本(Replication),確保Broker故障時數據不丟失、服務不間斷。必須建立完善的監控體系,關注集群吞吐量、網絡IO、磁盤使用率、消費延遲(Lag)等關鍵指標。

- 端到端的語義保障:根據業務需求,明確消息傳遞的語義(如至多一次、至少一次、恰好一次),并通過冪等生產者、事務API等機制予以實現。

###

Apache Kafka通過其以吞吐量和擴展性為核心的設計,為微服務架構提供了強大的異步通信骨干。在復雜的信息系統集成服務中,它不僅是消息傳遞的管道,更是實時數據流的統一平臺。深入理解其高性能原理,并在此基礎上進行合理的架構設計與運維,是構建敏捷、可靠、能夠應對海量數據挑戰的現代信息系統的關鍵所在。將Kafka融入系統集成藍圖,意味著選擇了面向未來流式數據世界的高性能路徑。